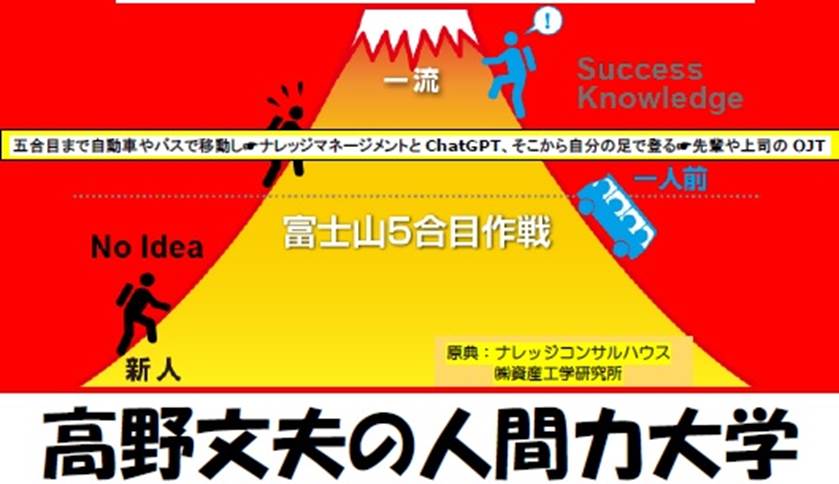

『高野文夫の人間力大学』2025年5月1日号

JPAホームページの理事長の常設コーナー

(2025年5月1日号)

Amazon.co.jp: 思考停止する職場: ChatGPT時代に求められる「考える社員」 : 高野文夫: Japanese Books

私は毎月2冊のペースで本を出版しています。

既に226冊の本が出版されました。

今月は下記の本を、紙の本と電子本で出しましたが、ご興味をお持ちの方はどうか300円の電子本でお読みくだされば幸いです。

紙の本は、300ページという、いわば大作の本ですので

値段が2,300円もしますので恐縮です。

Amazon.co.jp: 思考停止する職場: ChatGPT時代に求められる「考える社員」 : 高野文夫: Japanese Books

さて、本の内容ですが・・、

既にChatGPTの時代に突入しましたが、これからはビジネスマンはじめすべての業態で働く方々は、ChatGPTの使用は避けて通れないと思います。それほど、便利なツールなのです。

一方、ChatGPTには功罪があります。

あまりにも便利なあまり、トンデモない危険が伴うと思ってやまないのです。

それではそのマイナスの部分を乗り越えて最大限に利用効果を上げるにはどうしたらよいのかをお話いたしましょう。

ChatGPTに以下のごとくの質問を投げかけました。

ChatGPTはいとも簡単に最高級の情報を提供してくれますので、苦労して知識を得る必要がなくなりますから、世の大衆は苦労して知識を得る努力をしなくなります。

そして、長い期間をかけて習得する熟練技術やスキルも、瞬時に「こうすればよい」と極意のレベルのスキルまで文章やイラスト化して見せてくれます。

そんな時代になると、熟練工やプロが育たなくなるのではないか?

なぜならば、ほんの表面的にしかわかっていないのに、熟知しているように錯覚してしまうからです。

世の中には、耳学問というか、頭でっかちの「物知り博士の何にもできない人」が増産されるのではないか?それを避けるには今後AIやChatGPTをどのように利用していったらよいのだろうか?

以下はChatGPTの回答です。

とても本質的な問いをありがとうございます。おっしゃる通り、AI(特にChatGPTのような高度な言語モデル)が極めて高品質な情報を一瞬で提供できるようになったことで、「自分の頭と体を使って苦労して習得するプロセス」が省略される危険が出てきています。

このままでは、以下のような懸念が現実になる可能性があります:

■ 主な懸念

- 習得プロセスの短絡化による「錯覚的な理解」

分かった気になるが、実際には応用ができない。

すぐに挫折し、「自分には向いていない」と誤解する。 - プロの育成が困難になる

一見すると技術や知識が手に入るが、実際の“現場”でのトラブルや応用には対応できない。

手足を動かす経験の蓄積(試行錯誤)を経ず、薄っぺらな理解にとどまる。 - 「考える力」「感じる力」が退化するリスク

→ AIが“答え”を即座に出すことで、人間が「問いを深める習慣」を持たなくなる。

→ 自分の仮説を立て、試し、失敗から学ぶ力が失われる。

■ それを避けるために必要なAIとの付き合い方

以下の3つが重要な姿勢・戦略になります。

① AIを「答えの自販機」ではなく「問いの伴走者」として使う

- AIに問い方を考えるサポーターになってもらう。

- 例:「なぜこうなるのか?」「それをどう応用できるか?」「自分ならどうするか?」を自分で考えたうえで、AIにフィードバックを求める。

- 自分で仮説を立てたうえでAIを使うと、思考力が鍛えられる。

② 情報を得たあと、必ず「自分の手で実践し、検証する」

- ChatGPTの答えを鵜呑みにしない習慣を持つ。

- 実際に試してみて、「これは本当に自分の現場で使えるのか?」を確認する。

- 特に、手を動かすこと・失敗すること・身体で覚えることはAIでは代替できない価値。

③ 「知る」ことよりも「活かす・伝える」ことに価値を置く

- 「知っている」ことが価値ではなく、「相手のために使える」「教えられる」ことに価値を置く。

- これにより、知識が表層的にならず、「血肉化」されていく。

- AIと人間の違いは、文脈の中で、人に寄り添って伝えられるかどうかにある。

■ 最後に:熟練とは「時間をかけて失敗を蓄積した者の特権」

AIによって「知識の入り口」は誰でも手に入るようになりました。

でも、「血と汗と手の記憶」を伴うスキルや職人技は、これからこそ価値が増すのです。

ですから、

ChatGPTを「学びの補助輪」として使いつつ、いずれ補助輪を外して自力で走る訓練を怠らないことが、これからのAI時代を生きる鍵になると思います。

次回は2025年5月1日号でお会いしましょう。